Воқеалар тақвими

01.02.2024

Хоким Ташкентской области Зойир Мирзаев поручил добиться увольнения главврачей больниц в 10 городах и районах. По его словам, они закупают импортные лекарства вместо местных аналогов, используют «обнальные фирмы». Он также сообщил, что некоторые врачи выписывают по 8−10 лекарств в интересах аптек.

01.02.2024

Американцы, похоже, особенно склонны доверять искусственному интеллекту (ИИ).

Пациенты в США уже используют ChatGPT для получения информации о здоровье, постановки диагнозов и помощи в понимании того, что говорят им врачи. Согласно новому исследованию, проведенному среди 2 000 взрослых американцев, 52 % из нас передавали свои симптомы системе искусственного интеллекта, такой как ChatGPT.

Пациенты в США уже используют ChatGPT для получения информации о здоровье, постановки диагнозов и помощи в понимании того, что говорят им врачи. Согласно новому исследованию, проведенному среди 2 000 взрослых американцев, 52 % из нас передавали свои симптомы системе искусственного интеллекта, такой как ChatGPT.

31.01.2024

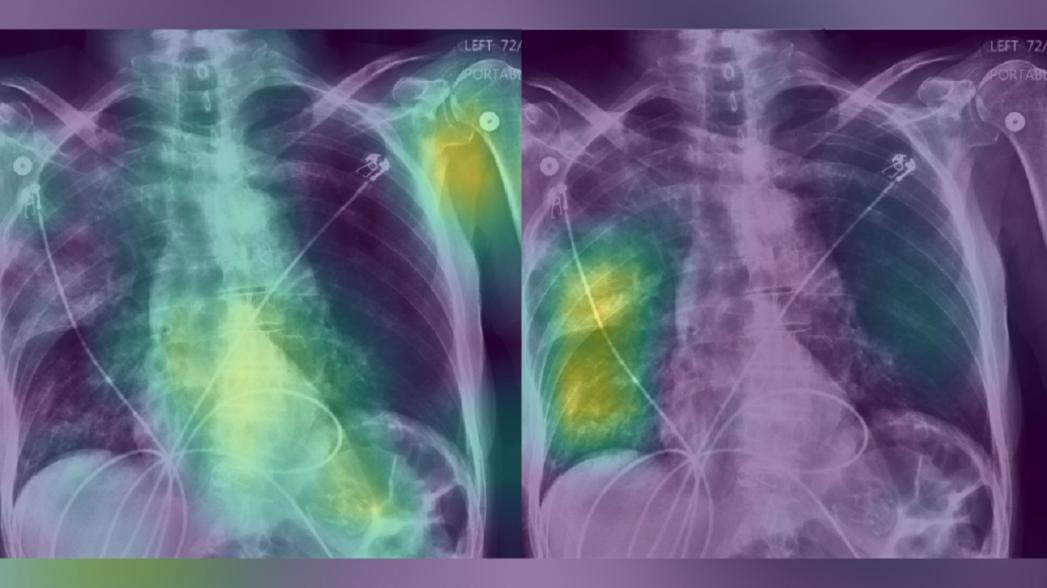

Рак молочной железы — один из лидеров по смертности среди онкозаболеваний в Узбекистане, но излечим на ранних стадиях. Для диагностирования нужны маммографы, обученные радиологи и рентген-лаборанты, говорится в колонке Офиса достижения результатов при Агентстве стратегических реформ для «Газеты.uz».

28.01.2024

Компания Withings представила BeamO - устройство для оценки состояния здоровья класса "4 в 1". Этот "мультископ", сочетающий в себе сенсоры ЭКГ, оксиметра, стетоскопа и термометра, позволяет следить за важнейшими показателями здоровья, которые традиционно измеряются на приеме у врача.

В устройстве установлены датчики, излучающие свет и получающие данные для интерпретации картины кровотока, температуры и акустической информации.

В устройстве установлены датчики, излучающие свет и получающие данные для интерпретации картины кровотока, температуры и акустической информации.

26.01.2024

Модели искусственного интеллекта (ИИ) в здравоохранении - это обоюдоострое оружие. Такие системы улучшают диагностические решения для одних категорий населения, но ухудшают решения для других, когда модель вбирает в себя необъективные медицинские данные.

Новое исследование, опубликованное в журнале JAMA, показало, что даже при наличии обоснований того, как было принято то или иное решение, врачи могут быть обмануты "предвзятыми" моделями ИИ.

Новое исследование, опубликованное в журнале JAMA, показало, что даже при наличии обоснований того, как было принято то или иное решение, врачи могут быть обмануты "предвзятыми" моделями ИИ.